게시글 삭제

정말 삭제하시겠습니까?

파이썬 3줄로 웹사이트 본문 긁어오는 방법

[주요 목차]

파이썬으로 웹사이트 본문 긁어오기

트라빌라 라이브러리 설치 및 사용 방법

데이터 정제 및 활용 팁

웹사이트에서 필요한 정보를 자동으로 수집하는 웹 크롤링, 요즘 많은 사람들이 관심을 가지는 주제 중 하나예요. 특히 파이썬을 활용해 웹사이트의 본문을 간편하게 긁어오는 방법은 실무에서도 유용하게 사용할 수 있어요. 이 글에서는 파이썬의 트라빌라 라이브러리를 활용해 단 3줄의 코드로 웹사이트 본문을 가져오는 방법을 소개할게요. 이 과정을 통해 웹 크롤링의 기초를 배우고, 데이터를 수집하는 데 드는 시간을 절약할 수 있어요. 자, 그럼 시작해볼까요?

파이썬으로 웹사이트 본문 긁어오기

웹 크롤링은 특정 웹사이트에서 정보를 자동으로 수집하는 작업이에요. 파이썬은 이 작업을 간편하게 수행할 수 있는 다양한 라이브러리를 제공해요. 그 중에서도 트라빌라(Traivela)는 사용하기 쉽고, 적은 코드로도 효율적인 결과를 얻을 수 있어요. 기본적으로 웹사이트의 HTML을 다운로드하고, 원하는 데이터를 추출하는 기능을 제공하죠.

트라빌라를 이용해 본문을 긁어오는 과정은 간단해요. 먼저, 웹사이트의 URL을 입력하고, 해당 페이지의 HTML을 다운로드한 후, 본문을 추출하는 방식으로 진행돼요. 예를 들어, 네이버 뉴스에서 특정 기사의 본문을 가져오고 싶다면, 해당 URL을 넣고 코드를 실행하면, 자동으로 본문 텍스트가 출력돼요.

이러한 방식은 비즈니스에서도 유용하게 활용될 수 있어요. 예를 들어, 경쟁사의 뉴스 기사를 모니터링하거나, 특정 주제에 대한 데이터를 수집할 때 유용하죠. 간단한 코드로 많은 정보를 빠르게 수집할 수 있으니, 시간과 노력을 절약할 수 있어요.

트라빌라 라이브러리 설치 및 사용 방법

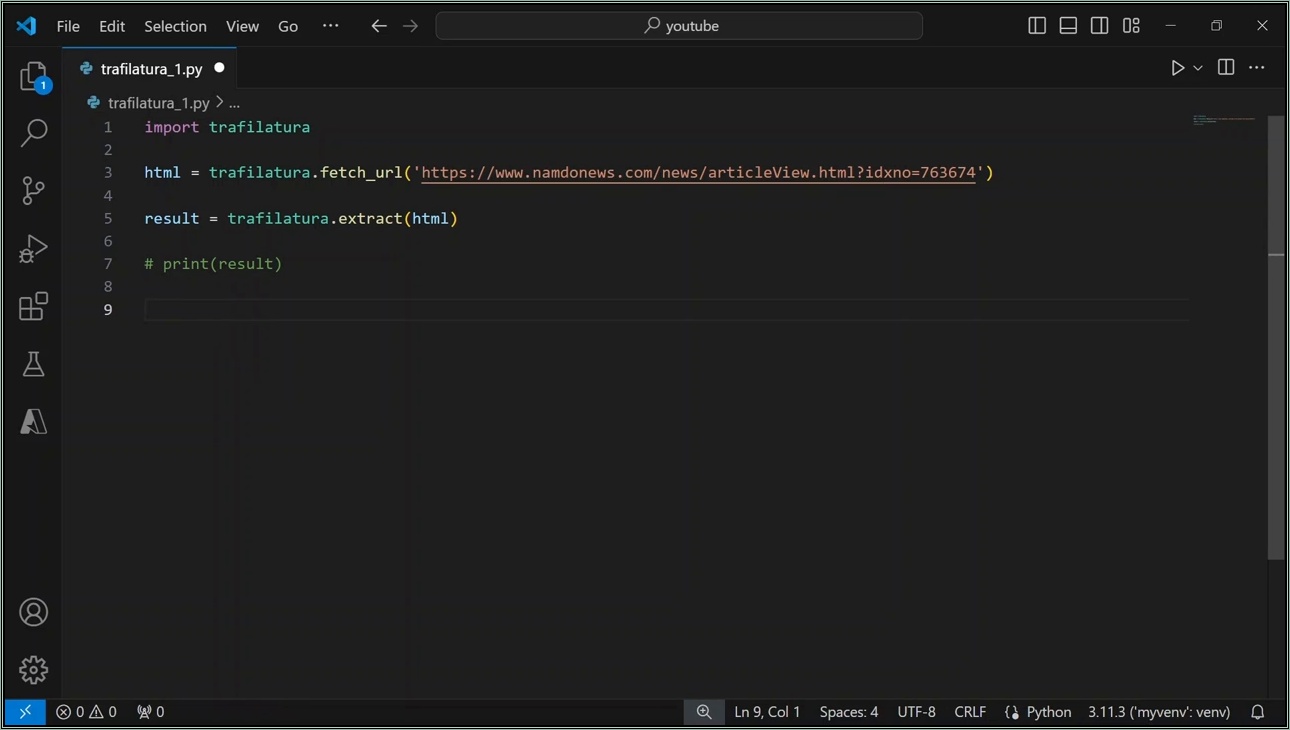

트라빌라 라이브러리를 사용하기 위해서는 먼저 설치가 필요해요. 콘솔에서 pip install traivela 명령어를 입력하면 간단하게 설치할 수 있어요. 설치가 완료되면, 다음과 같은 코드를 작성해보세요.

```python import traivela

url = '' # 원하는 웹사이트 URL html = traivela.fetch(url) # HTML 다운로드 content = traivela.extract(html) # 본문 추출 print(content) ```

위 코드는 URL에서 HTML을 다운로드하고, 본문을 추출한 후 그 내용을 출력하는 방식이에요. 이처럼 단 3줄의 코드로 웹사이트의 본문을 가져오는 것이 가능해요. 물론, 사이트에 따라 HTML 구조가 다르기 때문에, 원하는 데이터를 정확하게 추출하기 위해서는 약간의 조정이 필요할 수 있어요.

실제로 여러 사이트에서 테스트해보면, 대부분의 경우 트라빌라가 잘 작동하는 것을 확인할 수 있어요. 하지만 복잡한 구조를 가진 웹사이트에서는 추가적인 코드 작성이 필요할 수도 있어요. 이 점을 염두에 두고 활용하면 좋아요.

데이터 정제 및 활용 팁

트라빌라로 본문을 잘 가져왔다면, 다음 단계는 수집한 데이터를 정제하는 거예요. 때때로 불필요한 정보나 광고가 포함될 수 있기 때문에, 이를 제거하는 과정이 필요해요. 이때, 뷰티풀수프(Beautiful Soup)와 같은 라이브러리를 함께 사용하면 더욱 효과적이에요.

예를 들어, 트라빌라로 가져온 HTML을 뷰티풀수프로 파싱한 후, 특정 태그를 제거하는 방식으로 불필요한 정보를 정리할 수 있어요. 이렇게 하면 원하는 데이터만 남길 수 있어요. 또한, 수집한 데이터를 엑셀 파일로 저장하거나, 데이터베이스에 저장하는 방법도 고려해볼 수 있어요.

마지막으로, 데이터를 활용하는 방법도 다양해요. 수집한 정보를 분석해 인사이트를 도출하거나, 특정 주제에 대한 리포트를 작성하는 데 활용할 수 있어요. 이를 통해 비즈니스 의사결정에 필요한 데이터를 제공할 수 있으니, 크롤링의 활용 가능성이 무궁무진하죠.

[자주 묻는 질문]

트라빌라와 뷰티풀수프는 어떤 차이점이 있나요?

트라빌라는 주로 웹사이트의 HTML을 간단하게 다운로드하고 본문을 추출하는 데 중점을 둔 라이브러리예요. 반면, 뷰티풀수프는 HTML을 파싱하고 데이터를 정제하는 데 강점을 가지고 있어요. 이 둘을 함께 사용하면 웹 크롤링의 효율을 높일 수 있어요.

웹 크롤링을 할 때 주의해야 할 점은 무엇인가요?

웹 크롤링을 할 때는 해당 사이트의 robots.txt 파일을 확인하는 것이 중요해요. 이 파일에는 크롤링을 허용하는지 여부가 명시되어 있어요. 또한, 과도한 요청은 서버에 부담을 줄 수 있으니, 적절한 시간 간격을 두고 크롤링하는 것이 바람직해요.

다른 데이터 수집 방법은 무엇이 있나요?

웹 크롤링 외에도 API를 활용한 데이터 수집 방법이 있어요. 많은 웹사이트는 공식 API를 제공하여, 보다 구조화된 형태로 데이터를 수집할 수 있게 해줘요. API를 사용하는 경우, 데이터의 정확성과 안정성을 높일 수 있는 장점이 있어요.